这是 CapsWriter-Offline ,一个 PC 端的语音输入、字幕转录工具。

两个功能:

- 按下键盘上的

大写锁定键,录音开始,当松开大写锁定键时,就会识别你的录音,并将识别结果立刻输入 - 将音视频文件拖动到客户端打开,即可转录生成 srt 字幕

视频教程:CapsWriter-Offline 电脑端离线语音输入工具

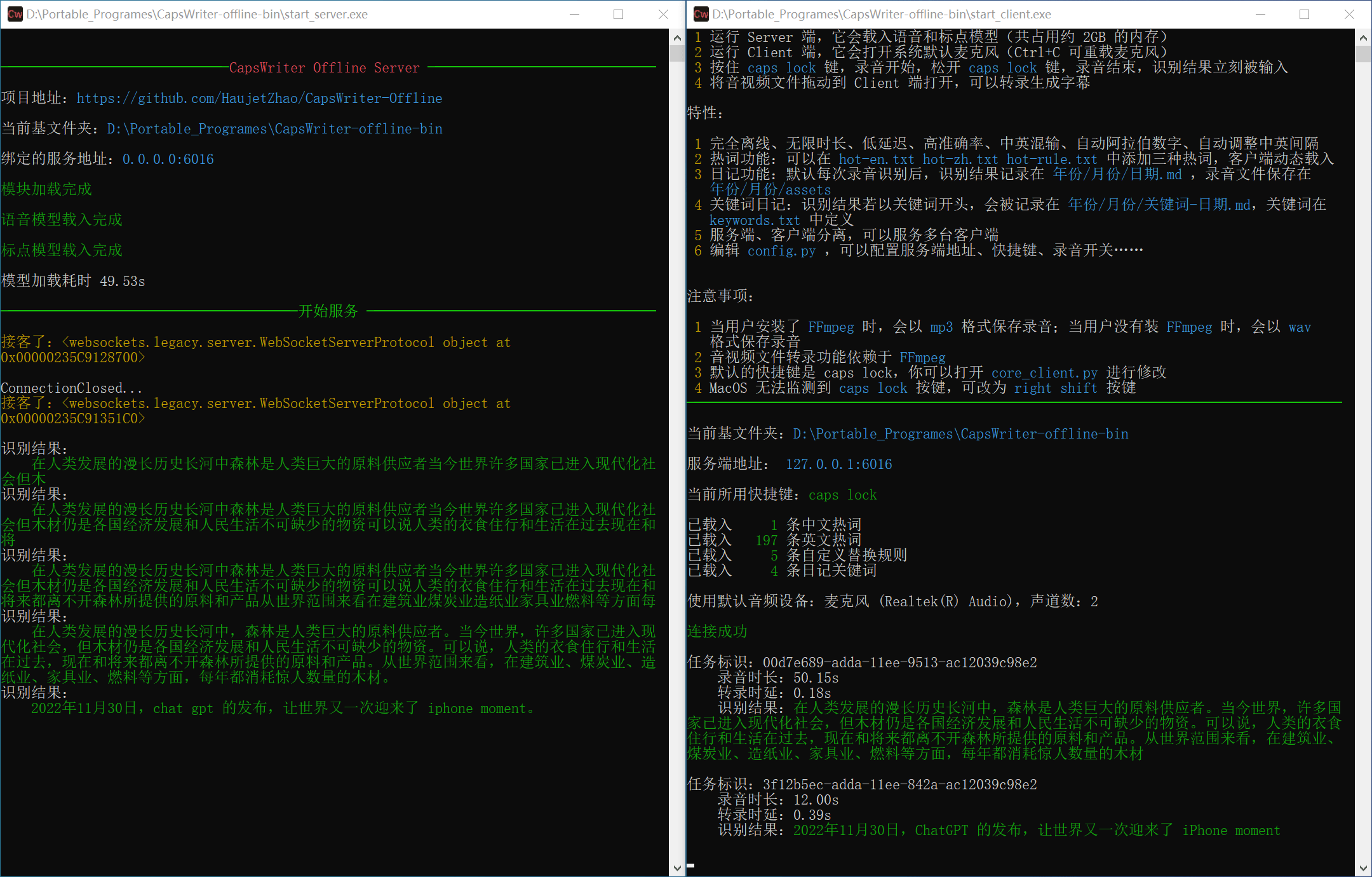

- 完全离线、无限时长、低延迟、高准确率、中英混输、自动阿拉伯数字、自动调整中英间隔

- 热词功能:可以在

hot-en.txt hot-zh.txt hot-rule.txt中添加三种热词,客户端动态载入 - 日记功能:默认每次录音识别后,识别结果记录在

年份/月份/日期.md,录音文件保存在年份/月份/assets - 关键词日记:识别结果若以关键词开头,会被记录在

年份/月份/关键词-日期.md,关键词在keywords.txt中定义 - 转录功能:将音视频文件拖动到客户端打开,即可转录生成 srt 字幕

- 服务端、客户端分离,可以服务多台客户端

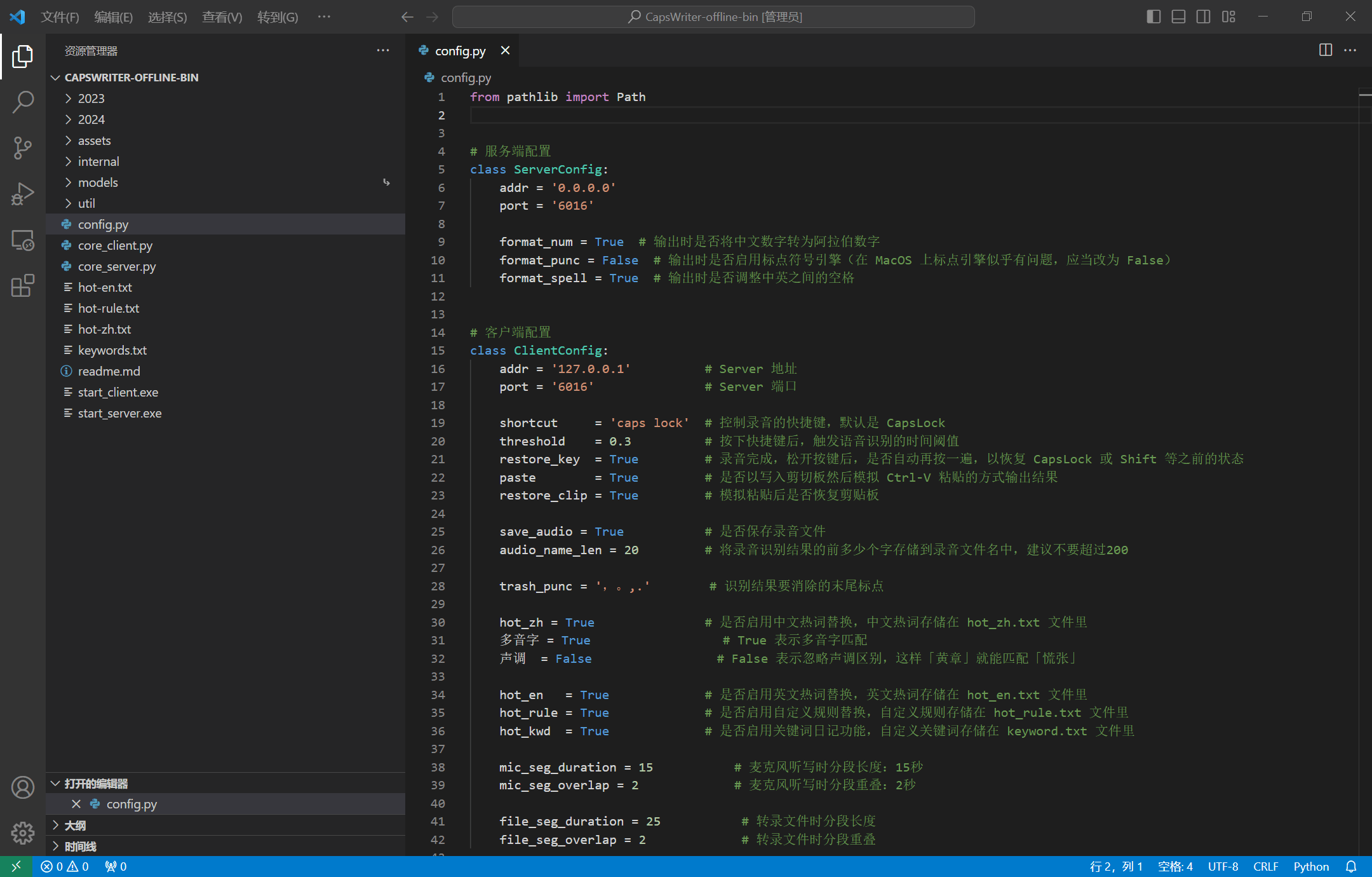

- 编辑

config.py,可以配置服务端地址、快捷键、录音开关……

对 Windows 端:

- 请确保电脑上安装了 Microsoft Visual C++ Redistributable 运行库

- 服务端载入模型所用的 onnxruntime 只能在 Windows 10 及以上版本的系统使用

- 服务端载入模型需要系统内存 4G,只能在 64 位系统上使用

- 额外打包了 32 位系统可用的客户端,在 Windows 7 及以上版本的系统可用

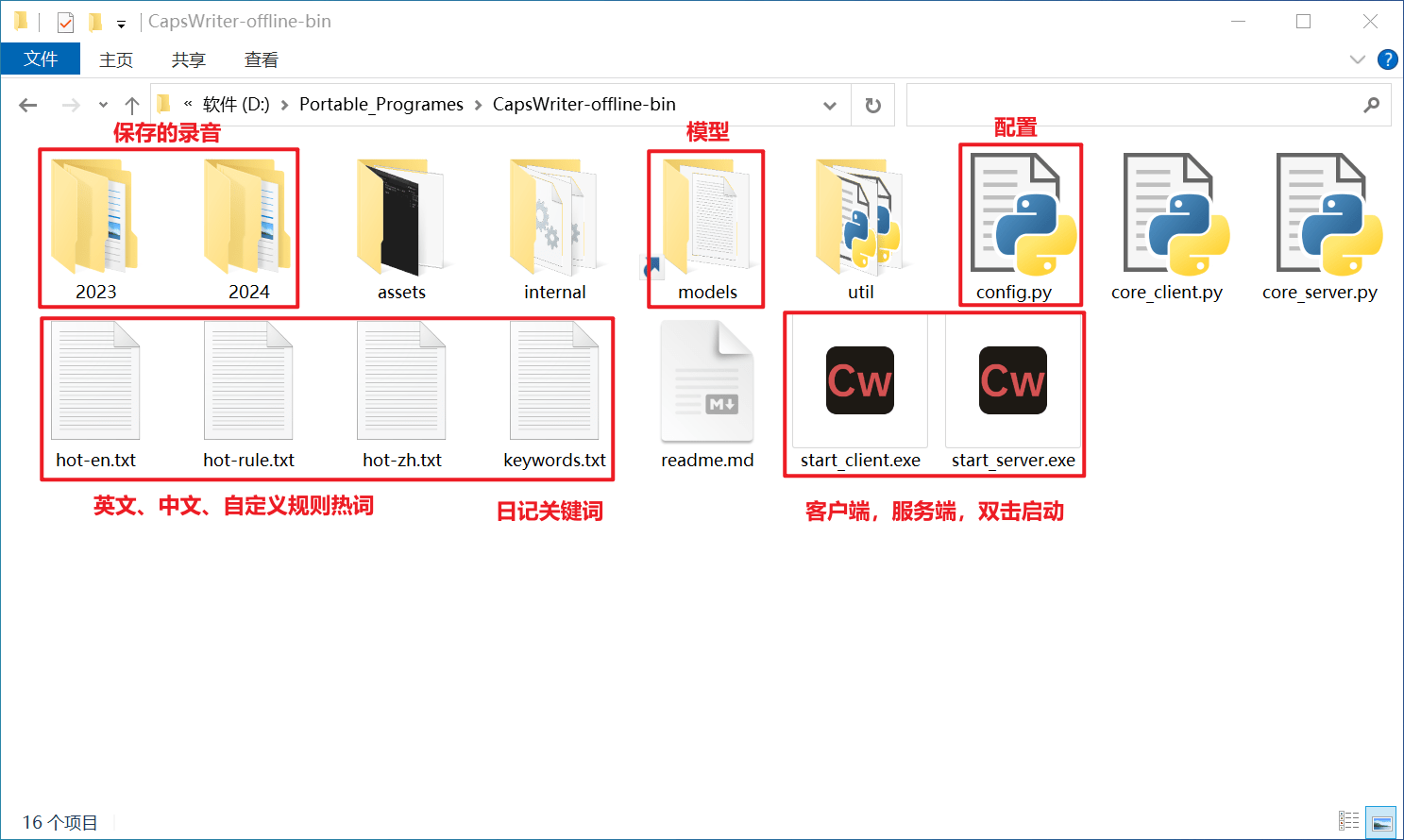

- 模型文件较大,单独打包,解压模型后请放入软件目录的

models文件夹中

其它系统:

- 其它系统,可以下载模型、安装依赖后从 Python 源码运行。

- 由于我没有 Mac 电脑,无法打包 Mac 版本,只能从源码运行,可能会有诸多问题要解决。(由于系统限制,客户端需要 sudo 启动,且默认快捷键为

right shift)

模型说明:

- 由于模型文件太大,为了方便更新,单独打包

- 解压模型后请放入软件目录的

models文件夹中

下载地址:

- 百度盘: https://pan.baidu.com/s/1zNHstoWZDJVynCBz2yS9vg 提取码: eu4c

- GitHub Release: Releases · HaujetZhao/CapsWriter-Offline

(百度网盘容易掉链接,补链接太麻烦了,我不一定会补链接。GitHub Releases 界面下载是最可靠的。)

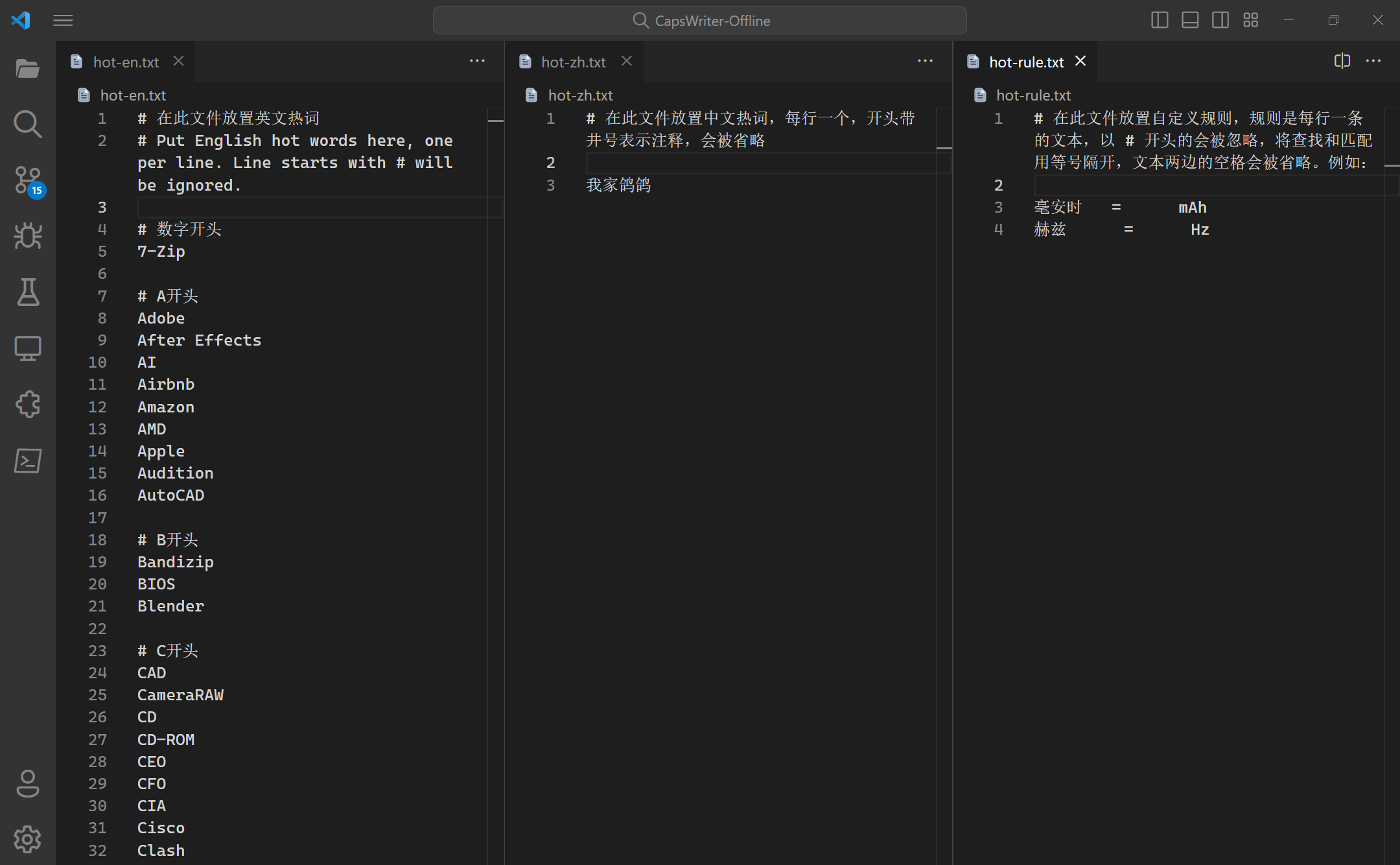

如果你有专用名词需要替换,可以加入热词文件。规则文件中以 # 开头的行以及空行会被忽略,可以用作注释。

-

中文热词请写到

hot-zh.txt文件,每行一个,替换依据为拼音,实测每 1 万条热词约引入 3ms 延迟 -

英文热词请写到

hot-en.txt文件,每行一个,替换依据为字母拼写 -

自定义规则热词请写到

hot-rule.txt文件,每行一个,将搜索和替换词以等号隔开,如毫安时 = mAh

你可以在 core_client.py 文件中配置是否匹配中文多音字,是否严格匹配拼音声调。

检测到修改后,客户端会动态载入热词,效果示例:

- 例如

hot-zh.txt有热词「我家鸽鸽」,则所有识别结果中的「我家哥哥」都会被替换成「我家鸽鸽」 - 例如

hot-en.txt有热词「ChatGPT」,则所有识别结果中的「chat gpt」都会被替换成「ChatGPT」 - 例如

hot-rule.txt有热词「毫安时 = mAh」,则所有识别结果中的「毫安时」都会被替换成「mAh」

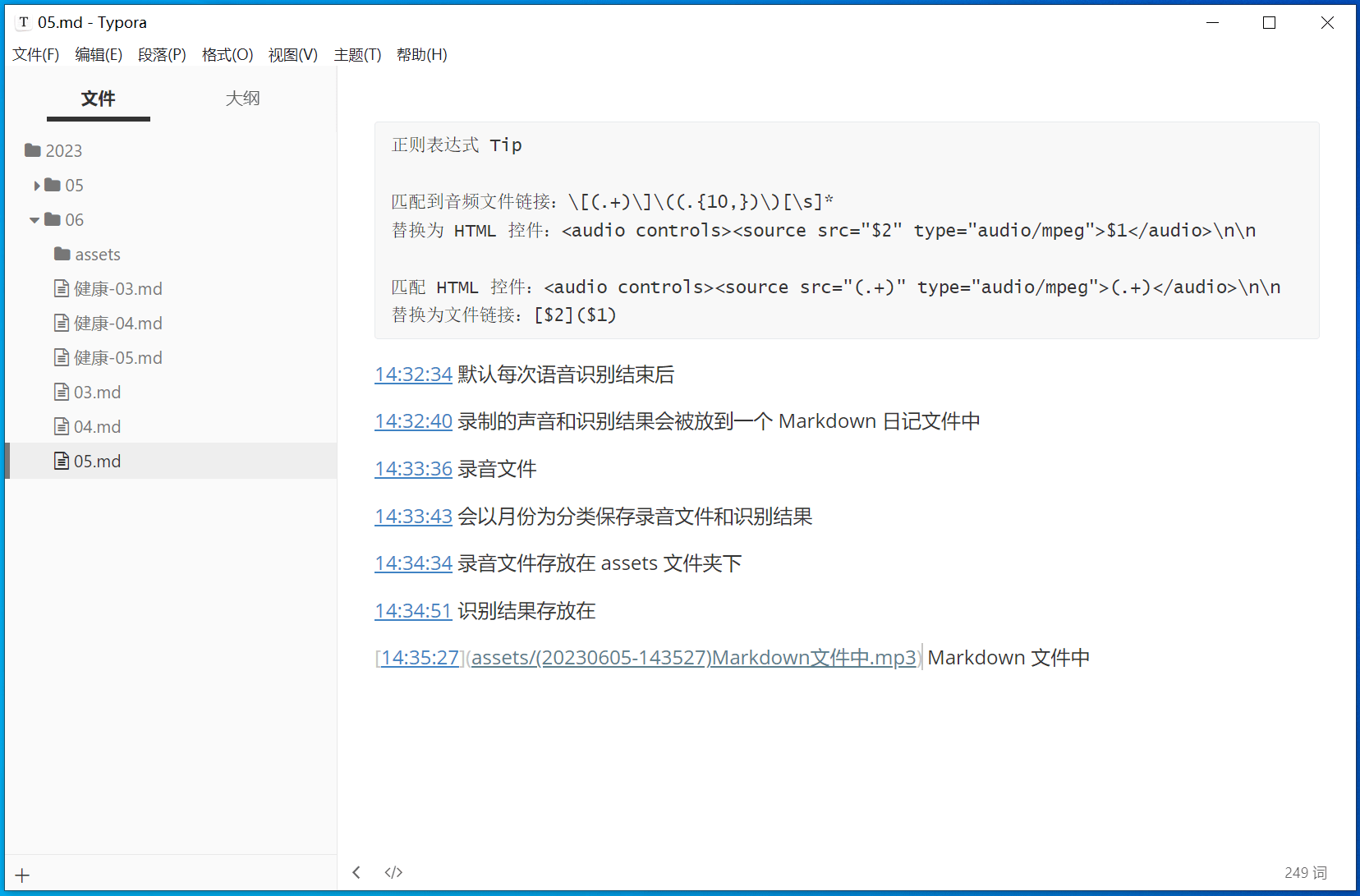

默认每次语音识别结束后,会以年、月为分类,保存录音文件和识别结果:

- 录音文件存放在「年/月/assets」文件夹下

- 识别结果存放在「年/月/日.md」Markdown 文件中

例如今天是2023年6月5号,示例:

- 语音输入任一句话后,录音就会被保存到

2023/06/assets路径下,以时间和识别结果命名,并将识别结果保存到2023/06/05.md文件中,方便我日后查阅 - 例如我在

keywords.txt中定义了关键词「健康」,用于随时记录自己的身体状况,吃完饭后我可以按住CapsLock说「健康今天中午吃了大米炒饭」,由于识别结果以「健康」关键词开头,这条识别记录就会被保存到2023/06/05-健康.md中 - 例如我在

keywords.txt中定义了关键词「重要」,用于随时记录突然的灵感,有想法时我就可以按住CapsLock说「重要,xx问题可以用xxxx方法解决」,由于识别结果以「重要」关键词开头,这条识别记录就会被保存到2023/06/05-重要.md中

在服务端运行后,将音视频文件拖动到客户端打开,即可转录生成四个同名文件:

json文件,包含了字级时间戳txt文件,包含了分行结果merge.txt文件,包含了带标点的整段结果srt文件,字幕文件

如果生成的字幕有微小错误,可以在分行的 txt 文件中修改,然后将 txt 文件拖动到客户端打开,客户端检测到输入的是 txt 文件,就会查到同名的 json 文件,结合 json 文件中的字级时间戳和 txt 文件中修正结果,更新 srt 字幕文件。

- 当用户安装了

FFmpeg时,会以mp3格式保存录音;当用户没有装FFmpeg时,会以wav格式保存录音 - 音视频文件转录功能依赖于

FFmpeg,打包版本已内置FFmpeg - 默认的快捷键是

caps lock,你可以打开core_client.py进行修改 - MacOS 无法监测到

caps lock按键,可改为right shift按键

你可以编辑 config.py ,在开头部分有注释,指导你修改服务端、客户端的:

- 连接的地址和端口,默认是

127.0.0.1和6006 - 键盘快捷键

- 是否要保存录音文件

- 要移除识别结果末尾的哪些标点,(如果你想把句尾的问号也删除掉,可以在这边加上)

服务端使用了 sherpa-onnx ,载入阿里巴巴开源的 Paraformer 模型(转为量化的onnx格式),来作语音识别,整个模型约 230MB 大小。下载有已转换好的模型文件:

另外,还使用了阿里巴巴的标点符号模型,大小约 1GB:

模型文件太大,并没有包含在 GitHub 库里面,你可以从百度网盘或者 GitHub Releases 界面下载已经转换好的模型文件,解压后,将 models 文件夹放到软件根目录

# for core_server.py

pip install -r requirements-server.txt -i https://mirror.sjtu.edu.cn/pypi/web/simple

# [NOTE]: kaldi-native-fbank==1.17(使用1.18及以上会报错`lib/python3.10/site-packages/_kaldi_native_fbank.cpython-310-x86_64-linux-gnu.so: undefined symbol: _ZN3knf24OnlineGenericBaseFeatureINS_22WhisperFeatureComputerEE13InputFinishedEv`)

# for core_client.py

pip install -r requirements-client.txt -i https://mirror.sjtu.edu.cn/pypi/web/simple

sudo apt-get install xclip # 让core_client.py正常运行运行方式

core_server.py # 无需以 root 权限运行

core_client.py # 注意: 必须以 root 权限运行!!

pip install -r requirements-server.txt

pip install -r requirements-client.txt有些依赖在 Python 3.11 还暂时不无法安装,建议使用 Python 3.8 - Python3.10

在 Arm 芯片的 MacOS 电脑上(如 MacBook M1)无法使用 pip 安装 sherpa_onnx ,需要手动从源代码安装:

git clone https://github.com/k2-fsa/sherpa-onnx

cd sherpa-onnx

python3 setup.py install

在 MacOS 上,安装 funasr_onnx 依赖的时候可能会报错,缺失 protobuf compiler,可以通过 brew install protobuf 解决。

- 运行

core_server.py脚本,会载入 Paraformer 模型识别模型和标点模型(这会占用2GB的内存,载入时长约 50 秒) - 运行

core_client.py脚本,它会打开系统默认麦克风,开始监听按键(MacOS端需要sudo) - 按住

CapsLock键,录音开始,松开CapsLock键,录音结束,识别结果立马被输入(录音时长短于0.3秒不算)

MacOS 端注意事项:

- MacOS 上监听

CapsLock键可能会出错,需要快捷键修改为其他按键,如right shift

Windows/MacOS/Linux均使用如下命令完成打包:

pyinstaller build.spec

如果你愿意,可以以打赏的方式支持我一下: