使用预训练语言模型BERT做中文NER尝试,fine - tune BERT模型

PS: 移步最新albert fine-tune ner模型

从BERT-TF下载bert源代码,存放在路径下bert文件夹中

从BERT-Base Chinese下载模型,存放在checkpoint文件夹下

使用BIO数据标注模式,使用人民日报经典数据

train:

python BERT_NER.py --data_dir=data/ --bert_config_file=checkpoint/bert_config.json --init_checkpoint=checkpoint/bert_model.ckpt --vocab_file=vocab.txt --output_dir=./output/result_dir/

经过100个epoch跑出来的结果

eval_f = 0.9662649

eval_precision = 0.9668882

eval_recall = 0.9656949

global_step = 135181

loss = 40.160034

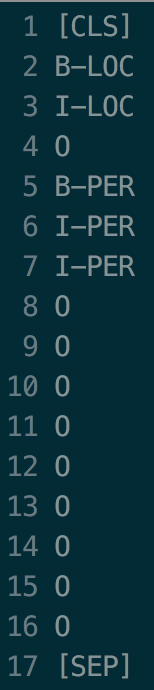

测试结果第一句: