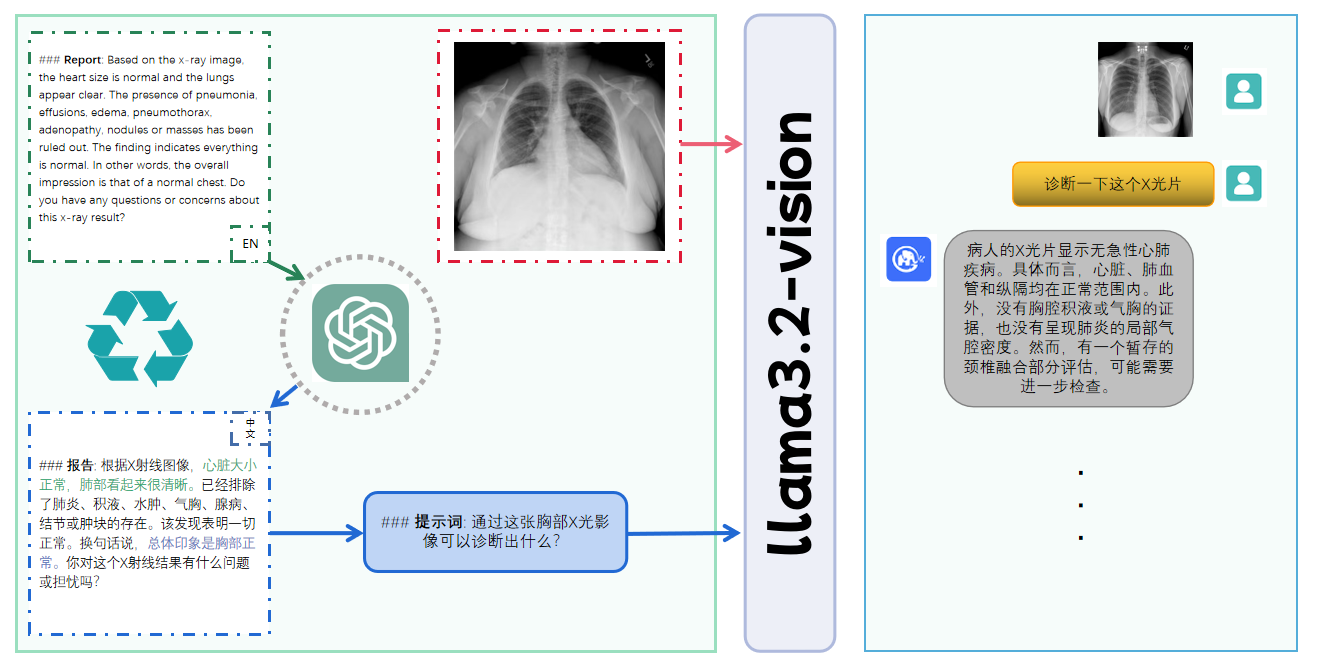

Xray Large Multi-model Model,基于llama3.2-vision微调Xray的多模态大模型,在4张VA800上基于llama3_2-11b-vision-instruct模型微调。详细介绍在博客:https://blog.csdn.net/u012193416/article/details/142735517

- 借助Xray开源数据集,基于llama3_2-11b-vision-instruct训练微调,并开放了用于学术研究的训练lora权重,推理时需要自行加载原始的llama3_2-11b-vision-instruct权重,可借助tools/swift_infer_merge_lora.sh进行权重合并。

- OpenI是一个来自印第安纳大学医院的胸部X光片数据集,包括6,459张图像和3,955个报告。

在上述工作中,报告信息都为非结构化的,不利于科学研究。为了生成合理的医学报告,我们对两个数据集进行了预处理,并最终得到了可以用于训练的英文报告。除此之外,为了更好的支持中文社区发展,借助ChatGPT的能力,我们将英文报告进行了中文翻译,并最终形成了可用于训练的数据集。

| 数据集 | 数量 | 下载链接 | 质量 |

|---|---|---|---|

| OpenI-zh | 6,423 | 诊疗报告(英文)、诊疗报告(中文) 、X光影像 | 低 |

| OpenI-zh-plus | 6,423 | - | 高 |

git clone https://github.com/modelscope/ms-swift.git

cd ms-swift

pip install -e .[llm]| 模型权重 | 下载链接 | 质量 | 微调方法 |

|---|---|---|---|

| checkpoints-XrayLLama3.2Vision-490 | results/llama32vision_swift_xray/llama3_2-11b-vision-instruct/v4-20241006-070501/checkpoint-490 | 低 | LoRA |

CUDA_VISIBLE_DEVICES=7 swift export \

--ckpt_dir "/home/lgd/e_commerce_lmm/results/llama32vision_swift_xray/llama3_2-11b-vision-instruct/v4-20241006-070501/checkpoint-490/" \

--merge_lora true

CUDA_VISIBLE_DEVICES=7 swift infer \

--ckpt "/home/lgd/e_commerce_lmm/results/llama32vision_swift_xray/llama3_2-11b-vision-instruct/v4-20241006-070501/checkpoint-490-merged/" \

--load_dataset_config true硬件资源

* 实验在A800 (4X, 80GB)上进行

sh tools/swift/swift_finetune_qwenvl_lora_ds.sh这里的复现过程非常简单,主要是很多过程我们都为大家准备好了,大家可以随时复现一个自己的XrayLLama3.2Vision。

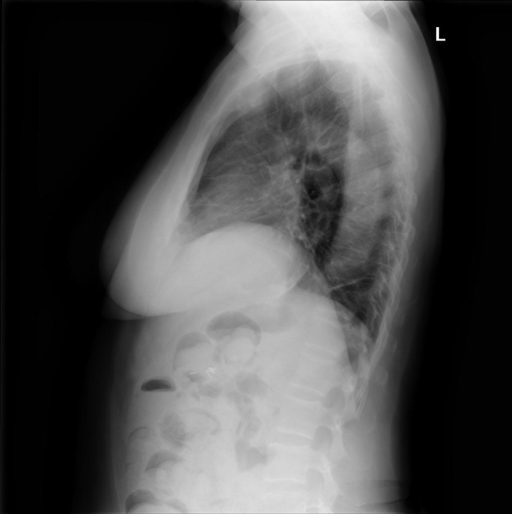

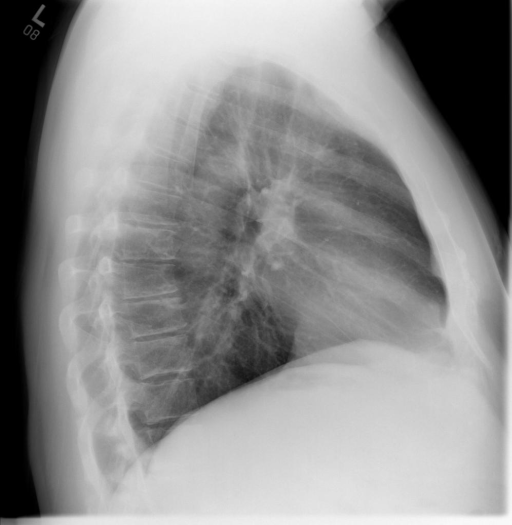

*以下效果来自于低质量的数据训练和权重

影像诊断:

本项目相关资源仅供学术研究之用,严禁用于商业用途。使用涉及第三方代码的部分时,请严格遵循相应的开源协议。模型生成的内容受模型计算、随机性和量化精度损失等因素影响,本项目无法对其准确性作出保证。即使本项目模型输出符合医学事实,也不能被用作实际医学诊断的依据。对于模型输出的任何内容,本项目不承担任何法律责任,亦不对因使用相关资源和输出结果而可能产生的任何损失承担责任。

此存储库遵循CC BY-NC-SA ,请参阅许可条款。