В данное работе представлены нейросети двух видов: ViT (vit_base_patch16_224_in21k[1]) и CNN(tf_efficientnetv2_m_in21k[2], resnetv2_50x1_bitm_in21k[3])

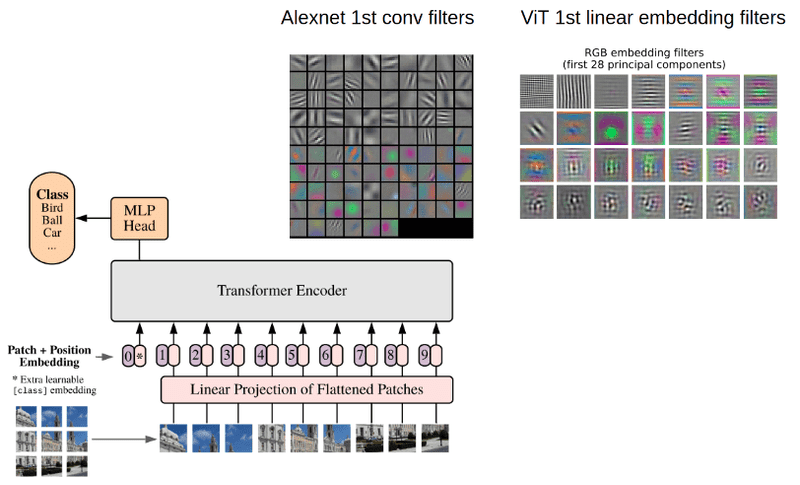

ViT - адаптация архитектуры трансформеров, применяемой в задачах NLP, для задач компьютерного зрения.

efficientnetv2 - модификация efficientnet, используется neural architecture search и модификация операции MBConv.

resnetv2 - модификация resnet, используется модификация Residual Block

Была написана программа на языке Python, которая тестирует вышеперечисленные нейросети, подсчитывается top 1 accuracy и top 5 accuracy.

| model | acc_1 | acc_5 | Memory usage (torch+model), MB | time, s |

|---|---|---|---|---|

| vit_base_patch16_224_in21k | 0.6 | 0.88 | 1073 | 0.36 |

| tf_efficientnetv2_m_in21k | 0.6 | 0.84 | 959 | 1.66 |

| resnetv2_50x1_bitm_in21k | 0.6 | 0.9 | 917 | 0.62 |

В результате экспериментов, было выяснено, что resnetv2_50x1_bitm_in21 обладает наибольшей точностью, потребляет меньше всего памяти и находится на втором месте по скорости работы.

[1] https://arxiv.org/abs/2010.11929

[2] https://arxiv.org/abs/2104.00298

[3] https://arxiv.org/abs/1912.11370