python 开发过程中常用到的工具;包括网站开发,人工智能,文件,数据类型转换

支付接口对接,外挂,bat,sh等我在工作中常用到的开发工具

- 制作一个可插拔的python开发工具

- 论文复现

- 深度学习tricks收集

所有的论文代码都在这里

pip uninstall python_developer_tools

pip install git+https://github.com/carlsummer/python_developer_tools.git

from python_developer_tools import cv

- cv 计算机视觉

- 基础组成成分

- input_conv 输入给网络之前的一步操作

- Convolution Series

- Depthwise Separable Convolution Usage

- MBConv

- Involution

- DY_Conv2d

- CoordConv2d

- attentions注意力机制

- Squeeze-and-Excitation Networks

- Residual Attention

- BN

- activates 激活函数

- ReLU

- LeakyReLU

- relu6

- SiLU

- sigmoid

- Swish

- Adaptively-Parametric-ReLU

- DynamicReLU

- softmax序列

- softmax

- norm_softmax

- sinmax

- norm_sinmax

- cosmax

- norm_cosmax

- sin_2_max

- norm_sin_2_max

- sin_2_max_move

- norm_sin_2_max_move

- sirenmax

- norm_sirenmax

- sin_softmax

- norm_sin_softmax

- serf

- [全连接FC]

- 池化pool

- SoftPool

- GlobalAvgPool2d

- BlurPool

- SPP

- regularization

- 分类classes

- datasets

- 数据增强

- 分类任务数据增强

- 图片自动对比度

- 直方图增强

- mix_data

- APR

- posterize

- rotate

- solarize

- shear_x

- shear_y

- translate_x

- translate_y

- color

- contrast

- brightness

- sharpness

- 直线检测数据增强

- 数据集读取

- [detection]

- scheduler

- ExpLR

- WarmupExponentialLR

- StepLR

- WarmupStepLR

- MultiStepLR

- WarmupMultiStepLR

- CosineLR

- WarmupCosineAnnealingLR

- LambdaLR

- ReduceLROnPlateau

- CosineAnnealingWarmRestarts

- CyclicLR

- OneCycleLR

- PolyLR

- optimizer

- SGD

- ASGD

- Adagrad

- Adadelta

- RMSprop

- Adam

- Adamax

- SparseAdam

- L-BFGS

- Rprop

- AdamW

- RAdam

- Ranger

- LARS

- post_processing后处理

- loss

- CenterLoss

- CrossEntropyLoss

- Diceloss

- focalloss

- LabelSmoothingCrossEntropy

- OHEMloss

- OIMloss

- topk_crossEntrophy

- TripletLoss

- NLLLoss

- train

- 不同数量卡训练

- 二阶段训练

- 自动混合精度训练

- 对抗训练

- FGSM

- BIM

- RFGSM

- CW

- PGD

- PGDL2

- EOTPGD

- FFGSM

- TPGD

- MIFGSM

- VANILA

- GN

- APGD

- APGDT

- FAB

- Square

- AutoAttack

- OnePixel

- DeepFool

- DIFGSM

- utils

- label标准工具

- files

- machinelearning

- [python]

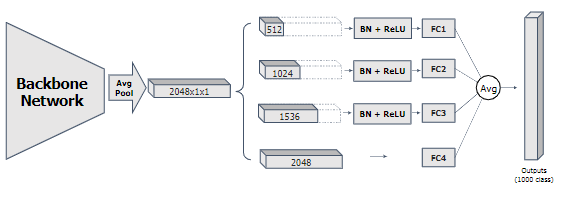

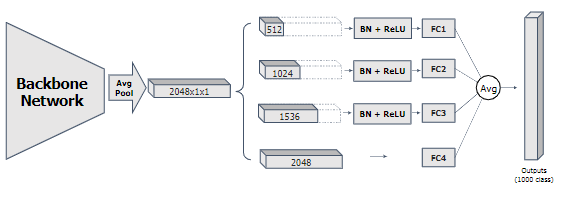

Exploiting Featureswith Split-and-Share Module

from python_developer_tools.cv.bases.FC.SSM import SSM

import torch

x = torch.randn(2, 2048, 1, 1)

x = x.view(x.size(0), -1)

model = SSM()

out = model(x)

print(out.shape)

| 名称 |

代码实例 |

| AlexNet |

实现 |

| DenseNet |

实现 |

| Efficientnet |

实现 |

| InceptionV1 |

实现 |

| InceptionV2 |

实现 |

| InceptionV3 |

实现 |

| repVGGNet |

实现 |

| ResNet |

实现 |

| ResNeXt |

实现 |

| VGGNet |

实现 |

| GhostNet |

实现 |

| MixNet |

实现 |

| MobileNetV1 |

实现 |

| MobileNetV2 |

实现 |

| MobileNetV3 |

实现 |

| MobileNetXt |

实现 |

| ShuffleNet |

实现 |

| ShuffleNetV2 |

实现 |

| SqueezeNet |

实现 |

| Xception |

实现 |

| 名称 | 功能 |

|---|

| init_seeds | 固定pytorch训练时所有的随机种子 |

| cuda2cpu | 将pytorch的变量从cuda内存中移动到cpu的内存中 |

| select_device | 选择训练设备 |

| collect_env_info | 打印python,cuda,cudnn,torch等版本 |

| labels_to_image_weights | 根据图片样本数量计算weights |

| init_cudnn | 加速训练还是追求模型性能 |

| get_world_size | 返回全局的整个的进程数 |

| get_rank | 执行该脚本的进程的rank |

| get_model_info | 计算模型的参数量和计算一张图片的计算量 |

| 名称 | 功能 |

|---|

| get_filename_suf_pix | 获取路径的文件名,后缀,父路径 |

| 名称 | 功能 |

|---|

| write_pkl | 将数据存储为pkl |

| read_pkl | 读取pkl文件的内容 |