- 本项目在GitHub上,会不定期更新,大家也可以提交ISSUE,地址为:

https://github.com/skymyyang/salt-k8s-ha - SaltStack自动化部署Kubernetes v1.15.4版本(支持HA、TLS双向认证、RBAC授权、Flannel网络、ETCD集群、Kuber-Proxy使用LVS等)。

- 测试通过系统:CentOS 8.1

- Kernel Version: 4.18.0-147.8.1.el8_1.x86_64

- salt-ssh: 3000.3-1.el8

- Kubernetes: v1.18.2

- Etcd: v3.4.9

- Docker-ce: v18.09.2

- Calico: v3.14.0

- CNI-Plugins: v0.8.6

- nginx: v1.18.0

建议部署节点:最少三个Master节点,请配置好主机名解析(必备)。以下是最小配置,否则可能不成功。

| IP地址 | Hostname | 最小配置 | Kernel Version |

|---|---|---|---|

| 192.168.200.181 | c8-node1 | Centos8.1 8G 4CPU | 4.18.0-147.8.1.el8_1.x86_64 |

| 192.168.200.182 | c8-node2 | Centos8.1 8G 4CPU | 4.18.0-147.8.1.el8_1.x86_64 |

| 192.168.200.183 | c8-node3 | Centos8.1 8G 4CPU | 4.18.0-147.8.1.el8_1.x86_64 |

| 192.168.200.184 | c8-node4 | Centos8.1 8G 4CPU | 4.18.0-147.8.1.el8_1.x86_64 |

- 使用Salt Grains进行角色定义,增加灵活性。

- 使用Salt Pillar进行配置项管理,保证安全性。

- 使用Salt SSH执行状态,不需要安装Agent,保证通用性。

- 使用Kubernetes当前最新版本v1.18.2,体验新特性。

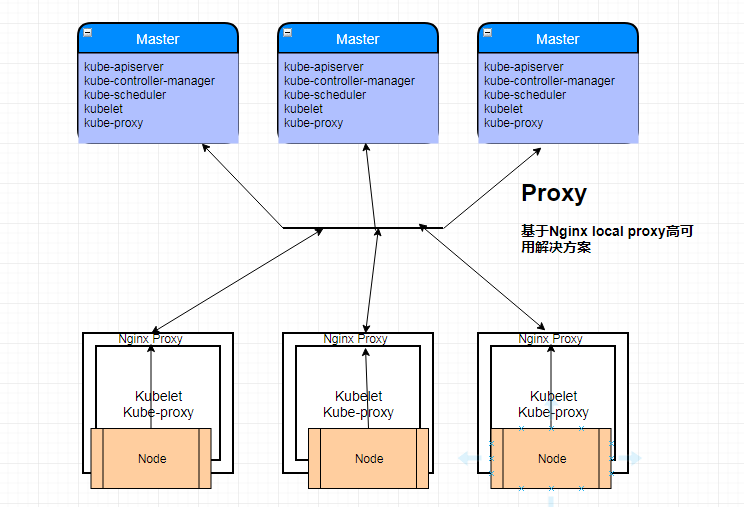

- 使用nginx来保证集群的高可用。

- KeepAlive+VIP的形式完成高可用的缺点

- 受限于使用者的网络,无法适用于SDN网络,比如Aliyun的VPC

- 虽然是高可用的,但是流量还是单点的,所有node的的网络I/O都会高度集中于一台机器上(VIP),一旦集群节点增多,pod增多,单机的网络I/O迟早是网络隐患。

- 本文的高可用可通用于任何云上的SDN环境和自建机房环境,列如阿里云的VPC环境中

- 本架构ETCD集群使用的是HTTP协议。

- 首先TLS的目的是为了鉴权为了防止别人任意的连接上你的etcd集群。其实意思就是说如果你要放到公网上的ETCD集群,并开放端口,我建议你一定要用TLS。

- 如果你的ETCD集群跑在一个内网环境比如(VPC环境),而且你也不会开放ETCD端口,你的ETCD跑在防火墙之后,一个安全的局域网中,那么你用不用TLS,都行。

-

本教程的来源于以下教程而生成,在此特别感谢两位作者。

-

和我一步步部署 kubernetes 集群

https://github.com/opsnull/follow-me-install-kubernetes-cluster -

SaltStack自动化部署Kubernetes

https://github.com/unixhot/salt-kubernetes

-

- 设置主机名!!!

[root@c8-node1 ~]# cat /etc/hostname

c8-node1.example.com

[root@c8-node2 ~]# cat /etc/hostname

c8-node2.example.com

[root@c8-node3 ~]# cat /etc/hostname

c8-node3.example.com

[root@c8-node4 ~]# cat /etc/hostname

c8-node4.example.com- 设置/etc/hosts保证主机名能够解析

[root@c8-node1 ~]# cat /etc/hosts

192.168.200.181 c8-node1 c8-node1.example.com

192.168.200.182 c8-node2 c8-node2.example.com

192.168.200.183 c8-node3 c8-node3.example.com

192.168.200.184 c8-node4 c8-node4.example.com

127.0.0.1 server.k8s.local- 关闭SELinux和防火墙,并配置chrony进行确保时间同步,由于centos8 默认使用NetworkManager,这里不能禁用。

shell> systemctl disable --now firewalld

shell> setenforce 0

shell> sed -ri '/^[^#]*SELINUX=/s#=.+$#=disabled#' /etc/selinux/config

shell> yum install chrony -y

shell> systemctl enable chronyd && systemctl restart chronyd- 以上必备条件必须严格检查,否则,一定不会部署成功!

[root@c8-node1 ~]# ssh-keygen -t rsa

[root@c8-node1 ~]# ssh-copy-id c8-node1

[root@c8-node1 ~]# ssh-copy-id c8-node2

[root@c8-node1 ~]# ssh-copy-id c8-node3

[root@c8-node1 ~]# ssh-copy-id c8-node4

[root@c8-node1 ~]# scp /etc/hosts c8-node2:/etc/

[root@c8-node1 ~]# scp /etc/hosts c8-node3:/etc/

[root@c8-node1 ~]# scp /etc/hosts c8-node4:/etc/2.1 安装Salt SSH(注意:老版本的Salt SSH不支持Roster定义Grains,需要2017.7.4以上版本),因此此salt版本基于Python3,所以以下命令需要在所有的节点上执行。

[root@linux-node1 ~]# yum install https://repo.saltstack.com/py3/redhat/salt-py3-repo-latest.el8.noarch.rpm -y

[root@linux-node1 ~]# sed -i "s/repo.saltstack.com/mirrors.aliyun.com\/saltstack/g" /etc/yum.repos.d/salt-py3-latest.repo

[root@linux-node1 ~]# yum install -y salt-ssh git unzip2.2 获取本项目 master 分支代码,并放置在 /srv 目录

[root@linux-node1 ~]# git clone https://github.com/skymyyang/salt-k8s-ha.git

[root@linux-node1 ~]# cd salt-k8s-ha/

[root@linux-node1 ~]# mv * /srv/

[root@linux-node1 srv]# /bin/cp /srv/roster /etc/salt/roster

[root@linux-node1 srv]# /bin/cp /srv/master /etc/salt/master2.4 下载二进制文件,也可以自行官方下载,为了方便国内用户访问,请在百度云盘下载,下载 k8s-v1.18.2-auto.7z 。

下载完成后,将文件移动到 /srv/salt/k8s/ 目录下,并解压,注意是 files 目录在 /srv/salt/k8s/目录下。

Kubernetes二进制文件下载地址: 链接:https://pan.baidu.com/s/1I_3PI8gsY1lvfd96zn7Zsg&shfl=sharepset

提取码:lfwq

[root@linux-node1 ~]# cd /srv/salt/k8s/

[root@linux-node1 k8s]# 7za x k8s-v1.15.4-auto.7z -r -o./

[root@linux-node1 k8s]# rm -f k8s-v1.15.4-auto.7z

[root@linux-node1 k8s]# ls -l files/

total 0

drwx------ 2 root root 94 Mar 18 13:41 cfssl-1.2

drwx------ 2 root root 195 Mar 18 13:41 cni-plugins-amd64-v0.7.4

drwx------ 3 root root 123 Mar 18 13:41 etcd-v3.3.13-linux-amd64

drwx------ 2 root root 47 Mar 18 13:41 flannel-v0.11.0-linux-amd64

drwx------ 3 root root 17 Mar 18 13:41 k8s-v1.15.4

drwx------ 2 root root 33 Mar 18 20:17 nginx-1.16.1- k8s-role: 用来设置K8S的角色

- etcd-role: 用来设置etcd的角色,如果只需要部署一个etcd,只需要在一台机器上设置即可

- etcd-name: 如果对一台机器设置了etcd-role就必须设置etcd-name

- worker-role: 所有节点均为worker节点

- ca-file-role: 定义c8-node1为证书生成节点

- kubelet-bootstrap-role: 在c8-node1上生成kubelet-bootstrap的kubeconfig配置文件,然后再拷贝至各个节点

- kubelet-role: 所有的节点都需要安装kubelet

- calico-role: 在c8-node1的管理节点上安装并配置calico网络

[root@linux-node1 ~]# vim /etc/salt/roster

c8-node1:

host: 192.168.200.181

user: root

priv: /root/.ssh/id_rsa

minion_opts:

grains:

worker-role: node

k8s-role: master

etcd-role: node

etcd-name: etcd-node1

admin-role: admin

calico-role: admin

c8-node2:

host: 192.168.200.182

user: root

priv: /root/.ssh/id_rsa

minion_opts:

grains:

k8s-role: master

etcd-role: node

etcd-name: etcd-node2

worker-role: node

c8-node3:

host: 192.168.200.183

user: root

priv: /root/.ssh/id_rsa

minion_opts:

grains:

k8s-role: master

etcd-role: node

etcd-name: etcd-node3

worker-role: node

c8-node4:

host: 192.168.200.184

user: root

priv: /root/.ssh/id_rsa

minion_opts:

grains:

k8s-role: node

worker-role: node#设置Master的IP地址(必须修改)

MASTER_IP_M1: "192.168.200.181"

MASTER_IP_M2: "192.168.200.182"

MASTER_IP_M3: "192.168.200.183"

#设置Master的HOSTNAME完整的FQDN名称(必须修改)

MASTER_H1: "c8-node1.example.com"

MASTER_H2: "c8-node2.example.com"

MASTER_H3: "c8-node3.example.com"

#KUBE-APISERVER的反向代理地址端口

#KUBE_APISERVER: "https://127.0.0.1:8443"

KUBE_APISERVER: "https://server.k8s.local:8443"

KUBE_APISERVER_DNS_NAME: "server.k8s.local"

#设置ETCD集群访问地址(必须修改)

ETCD_ENDPOINTS: "http://192.168.200.181:2379,http://192.168.200.182:2379,http://192.168.200.183:2379"

FLANNEL_ETCD_PREFIX: "/kubernetes/network"

#设置ETCD集群初始化列表(必须修改)

ETCD_CLUSTER: "etcd-node1=http://192.168.200.181:2380,etcd-node2=http://192.168.200.182:2380,etcd-node3=http://192.168.200.183:2380"

#通过Grains FQDN自动获取本机IP地址,请注意保证主机名解析到本机IP地址

NODE_IP: {{ grains['fqdn_ip4'][0] }}

HOST_NAME: {{ grains['fqdn'] }}

#设置BOOTSTARP的TOKEN,可以自己生成

BOOTSTRAP_TOKEN: "be8dad.da8a699a46edc482"

TOKEN_ID: "be8dad"

TOKEN_SECRET: "da8a699a46edc482"

ENCRYPTION_KEY: "8eVtmpUpYjMvH8wKZtKCwQPqYRqM14yvtXPLJdhu0gA="

#配置Service IP地址段

SERVICE_CIDR: "10.96.0.0/16"

#Kubernetes服务 IP (从 SERVICE_CIDR 中预分配)

CLUSTER_KUBERNETES_SVC_IP: "10.96.0.1"

#Kubernetes DNS 服务 IP (从 SERVICE_CIDR 中预分配)

CLUSTER_DNS_SVC_IP: "10.96.0.2"

#设置Node Port的端口范围

NODE_PORT_RANGE: "30000-32767"

#设置POD的IP地址段,在kube-controller-manager中定义cluster-cidr

POD_CIDR: "10.244.0.0/16"

CLUSTER_CIDR: "10.244.0.0/16"

#设置集群的DNS域名

CLUSTER_DNS_DOMAIN: "cluster.local."

#已注释不在需要

#设置Docker Registry地址

#DOCKER_REGISTRY: "https://192.168.150.135:5000"

#设置Master的VIP地址(必须修改)

#MASTER_VIP: "192.168.150.253"

#设置网卡名称,一定要改

VIP_IF: "ens192"

5.1 测试Salt SSH联通性以及基础设置

[root@k8s-m1 ~]# salt-ssh '*' test.ping执行高级状态,会根据定义的角色再对应的机器部署对应的服务

[root@c8-node1 ~]# salt-ssh -L '*' state.sls k8s.baseset5.2 部署Etcd,由于Etcd是基础组建,需要先部署,目标为部署etcd的节点。

增加etcd参数的优化。

-

--auto-compaction-retention由于ETCD数据存储多版本数据,随着写入的主键增加历史版本需要定时清理,默认的历史数据是不会清理的,数据达到2G就不能写入,必须要清理压缩历史数据才能继续写入;所以根据业务需求,在上生产环境之前就提前确定,历史数据多长时间压缩一次;推荐一小时压缩一次数据这样可以极大的保证集群稳定,减少内存和磁盘占用 -

--max-request-bytesetcd Raft消息最大字节数,ETCD默认该值为1.5M; 但是很多业务场景发现同步数据的时候1.5M完全没法满足要求,所以提前确定初始值很重要;由于1.5M导致我们线上的业务无法写入元数据的问题,我们紧急升级之后把该值修改为默认32M,但是官方推荐的是10M,大家可以根据业务情况自己调整 -

--quota-backend-bytesETCD db数据大小,默认是2G,当数据达到2G的时候就不允许写入,必须对历史数据进行压缩才能继续写入;参加1里面说的,我们启动的时候就应该提前确定大小,官方推荐是8G,这里我们也使用8G的配置

[root@linux-node1 ~]# salt-ssh -L 'c8-node1,c8-node2,c8-node3' state.sls k8s.etcd注:如果执行失败,新手建议推到重来,请检查各个节点的主机名解析是否正确(监听的IP地址依赖主机名解析)。

5.3 部署K8S集群-Master节点

这里首先安装master,由于worker节点的flannel的kubeconfig配置文件依赖API-server,所以必须先要部署master节点。

#1. 先生成master相关的证书

[root@c8-node1 ~]# salt-ssh -L 'c8-node1' state.sls k8s.modules.ca-file-generate

#2. 部署master节点

[root@c8-node1 ~]# salt-ssh -L 'c8-node1,c8-node2,c8-node3' state.sls k8s.master由于包比较大,这里执行时间较长,5分钟+,喝杯咖啡休息一下,如果执行有失败可以再次执行即可!执行过程中存在cfssl生成证书的warning,大家可以忽略。

5.4 生成kubelet-bootstrap-kubeconfig配置文件

[root@c8-node1 ~]# salt-ssh -L 'c8-node1' state.sls k8s.modules.kubelet-bootstrap-kubeconfig5.5 部署K8S集群worker节点,由于master也要安装kubelet以及kube-proxy,这里需要全部安装

[root@c8-node1 ~]# salt-ssh 'c8-node1,c8-node2,c8-node3,c8-node4' state.sls k8s.node5.6 部署calico网络以及coredns

[root@c8-node1 ~]# salt-ssh -L 'c8-node1' state.sls k8s.modules.calico5.7 设置每个节点的roles

#在master节点上执行,并为master节点加上污点Taint

kubectl label node c8-node1 node-role.kubernetes.io/master=""

kubectl label node c8-node2 node-role.kubernetes.io/master=""

kubectl label node c8-node3 node-role.kubernetes.io/master=""

kubectl taint nodes c8-node1 node-role.kubernetes.io/master="":NoSchedule

kubectl taint nodes c8-node2 node-role.kubernetes.io/master="":NoSchedule

kubectl taint nodes c8-node3 node-role.kubernetes.io/master="":NoSchedule

#在node节点上执行

kubectl label node c8-node4 node-role.kubernetes.io/worker=worker#先验证etcd

[root@linux-node1 ~]# source /etc/profile

[root@linux-node1 ~]# etcdctl --endpoints=http://192.168.200.181:2379 cluster-health

member 1b59c715892a07 is healthy: got healthy result from http://192.168.200.183:2379

member 5a23180c9f872e86 is healthy: got healthy result from http://192.168.200.182:2379

member edf2d8c54db4c5e1 is healthy: got healthy result from http://192.168.200.181:2379

cluster is healthy

[root@linux-node1 ~]# etcdctl --endpoints=http://192.168.200.181:2379 member list

1b59c715892a07: name=etcd-node3 peerURLs=http://192.168.200.183:2380 clientURLs=http://192.168.200.183:2379 isLeader=true

5a23180c9f872e86: name=etcd-node2 peerURLs=http://192.168.200.182:2380 clientURLs=http://192.168.200.182:2379 isLeader=false

edf2d8c54db4c5e1: name=etcd-node1 peerURLs=http://192.168.200.181:2380 clientURLs=http://192.168.200.181:2379 isLeader=false

[root@linux-node1 ~]# kubectl get cs

NAME STATUS MESSAGE ERROR

controller-manager Healthy ok

scheduler Healthy ok

etcd-2 Healthy {"health":"true"}

etcd-1 Healthy {"health":"true"}

etcd-0 Healthy {"health":"true"}

[root@linux-node1 ~]# kubectl get node

NAME STATUS ROLES AGE VERSION

linux-node1 Ready master 17m v1.15.4

linux-node2 Ready master 16m v1.15.4

linux-node3 Ready master 16m v1.15.4

linux-node4 Ready worker 9m39s v1.15.4[root@linux-node1 ~]# kubectl create deployment nginx --image=nginx:alpine

deployment.apps/nginx created

需要等待拉取镜像,可能稍有的慢,请等待。

[root@linux-node1 ~]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-54458cd494-zp9zp 1/1 Running 0 69s 10.244.2.2 linux-node3 <none> <none>

测试联通性

[root@linux-node1 ~]# ping -c 1 10.244.2.2

PING 10.2.1.2 (10.2.1.2) 56(84) bytes of data.

64 bytes from 10.2.1.2: icmp_seq=1 ttl=61 time=0.729 ms

--- 10.2.1.2 ping statistics ---

1 packets transmitted, 1 received, 0% packet loss, time 0ms

rtt min/avg/max/mdev = 0.729/0.729/0.729/0.000 ms

[root@linux-node1 ~]# curl --head http://10.244.2.2

HTTP/1.1 200 OK

Server: nginx/1.15.9

Date: Tue, 19 Mar 2019 05:36:47 GMT

Content-Type: text/html

Content-Length: 612

Last-Modified: Fri, 08 Mar 2019 03:05:13 GMT

Connection: keep-alive

ETag: "5c81dbe9-264"

Accept-Ranges: bytes

测试扩容,将Nginx应用的Pod副本数量拓展到2个节点

[root@linux-node1 ~]# kubectl scale deployment nginx --replicas=2

deployment.extensions/nginx scaled

[root@linux-node1 ~]# kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-54458cd494-nf946 1/1 Running 0 13s

nginx-54458cd494-zp9zp 1/1 Running 0 3m57s- 1.设置SSH无密码登录,并且在

/etc/hosts中继续增加对应的解析。确保所有节点都能解析。 - 2.在

/etc/salt/roster里面,增加对应的机器。 - 3.执行SaltStack状态

salt-ssh 'linux-node5' state.highstate

[root@linux-node5 ~]# vim /etc/salt/roster

linux-node5:

host: 192.168.200.185

user: root

priv: /root/.ssh/id_rsa

minion_opts:

grains:

k8s-role: node

[root@linux-node1 ~]# salt-ssh 'linux-node5' state.highstate你可以安装Kubernetes必备的插件

| 必备插件 | 1.CoreDNS部署 | 2.Dashboard部署 | 3.heapster部署 | 4.Metrics Server |

| 必备插件 | 5.Ingress-nginx部署 | 6.Ingress扩展 | 7.MetalLB | 8.Helm部署 |

PS:这里配置不一样的话需要修改yaml文件。

[root@linux-node1 ~]# systemctl disable kube-proxy

[root@linux-node1 ~]# systemctl stop kube-proxy

[root@linux-node1 ~]# kubectl apply -f /srv/addons/kube-proxy/kube-proxy.yml

[root@linux-node1 ~]# kubectl get pod -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-cd7f66fdc-fxvx6 1/1 Running 2 18h

coredns-cd7f66fdc-ldjnh 1/1 Running 2 18h

kube-proxy-czxj9 1/1 Running 2 16h

kube-proxy-pjpt5 1/1 Running 2 16h

kube-proxy-wpfrh 1/1 Running 2 16h

kube-proxy-zgg6t 1/1 Running 2 16h手动安装

| 手动部署 | 1.系统初始化 | 2.Nginx部署 | 3.CA部署 | 4.ETCD集群部署 | 5.Master节点部署 | 6.Node节点部署 | 7.Flannel部署 |

插件安装请参考文档必备插件的部分。

在实际应用中,想要缩短Pod重启时间,可以修改kube-controller-manager配置中的以下几个参数:

--node-monitor-grace-period=10s \

--node-monitor-period=3s \

--node-startup-grace-period=20s \

--pod-eviction-timeout=10s \

kubernetes节点失效后pod的调度过程:

- Master每隔一段时间和node联系一次,判定node是否失联,这个时间周期配置项为 node-monitor-period ,默认5s

- 当node失联后一段时间后,kubernetes判定node为notready状态,这段时长的配置项为 node-monitor-grace-period ,默认40s

- 当node失联后一段时间后,kubernetes判定node为unhealthy,这段时长的配置项为 node-startup-grace-period ,默认1m0s

- 当node失联后一段时间后,kubernetes开始删除原node上的pod,这段时长配置项为 pod-eviction-timeout ,默认5m0s

在管理k8s集群的时候,kubectl是我们经常使用的命令工具,由于本身kubectl的复杂性和api选项的过多,都给我们日常工作带来了不小的挑战,故这里介绍一下kubectl命令补全工具的安装

- 安装bash-completion

$yum install -y bash-completion

$source /usr/share/bash-completion/bash_completion- 应用kubectl的completion到系统环境中

$echo "source <(kubectl completion bash)" >> ~/.bashrc

$source ~/.bashrc接下来就可以愉快的进行命令补全了。