anythingllm文档:https://github.com/Mintplex-Labs/anything-llm

Ollama文档:https://ollama.com/

命令 cd server , cd frontend 安装 pnpm installwindows系统本地:

yarn run prisma:setup

yarn run dev:server-windows

yarn run dev:collector-windows

yarn run dev:frontend-windows mac 系统本地:

yarn run dev:server

yarn run dev:collector

yarn run dev:frontenddocker本地 cd docker docker-compose up -d --build

温馨提示

缓存在server目录的storage中,移除就可以初始化了Ollama: 下载模型,一般都是Ollama下载模型,具体看官方文档

———————————————————————————————————————————

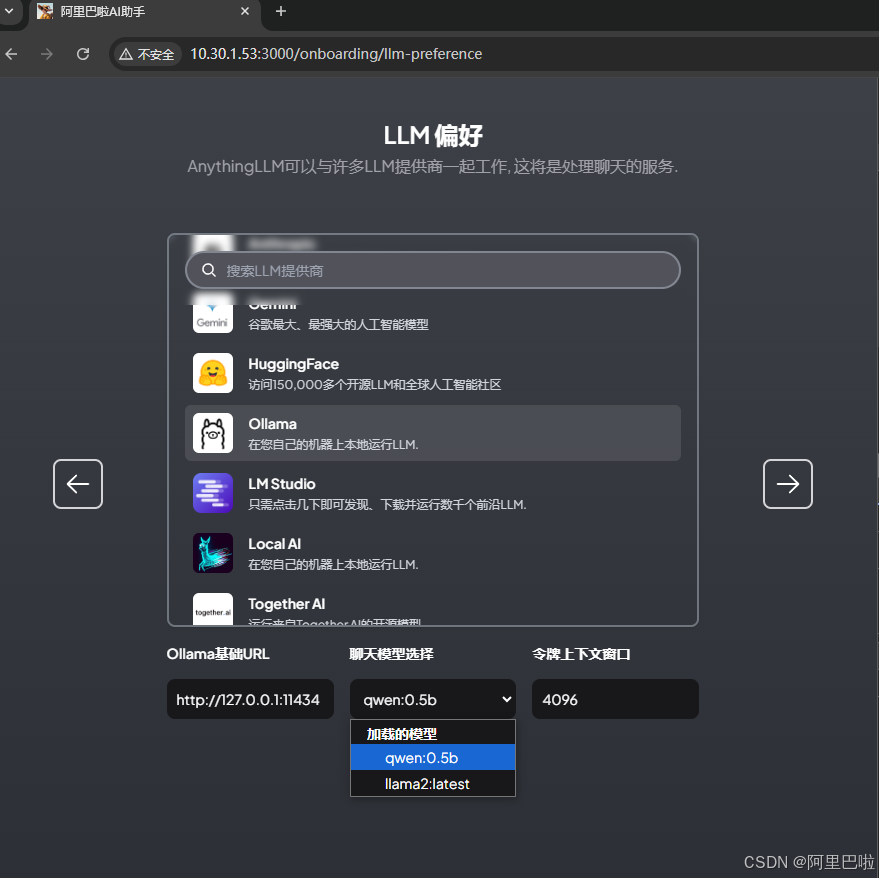

部分截图: