论文笔记&复现:SeHGNN, 2022, arXiv。

提出了一种新的==基于元路径==的HGNN。

- 作者发现同一种关系下的==node-level attention是不需要的==,用mean即可。于是作者移除了训练阶段的neighbor aggregation,放在了预处理步骤,这样==只需一次neighbor aggregation==。

- 提出一种新的==transformer-based semantic aggregator==来聚合不同元路径的不同语义信息。

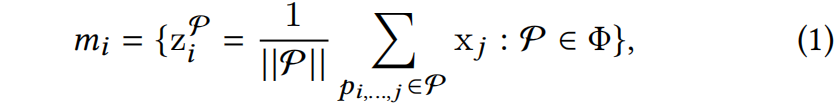

对于异构图中每个结点,通过==mean==聚合其==基于元路径的邻居==的特征,得到该结点基于该元路径的表征:

其中,$p_{i, ..., j}$表示元路径$P$的一个实例,从结点$i$到结点$j$。

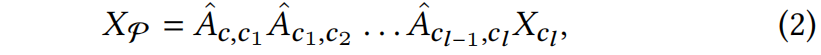

为了简化这步操作,采用==邻接矩阵的累乘==来计算semantic feature matrices。具体地,记$X_c$为结点类型为$c$的所有结点的原始特征构成的矩阵,$\hat{A}_{c, c_1}$表示从结点类型$c$到结点类型$c_1$的==邻接矩阵的row-normalized==形式,则==简化后的邻居聚合==过程为:

其中,$P = c c_1 c_2 ... c_l$是一条长度为$l+1$的元路径。

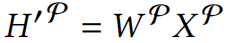

不同的元路径采用不同的矩阵变换:

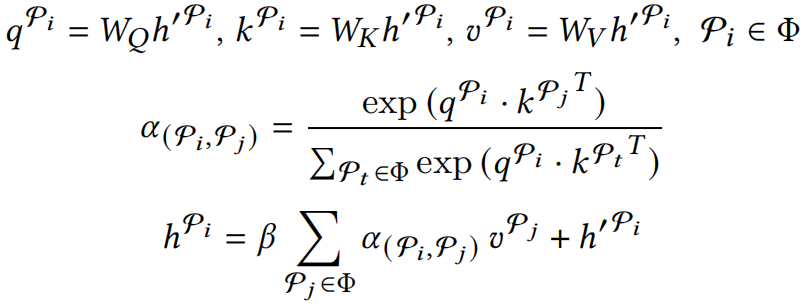

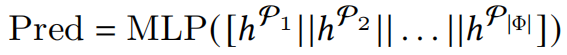

通过上述步骤,假设有$K$条元路径,为每个结点生成$K$个表征${ h'^{P_1}, ..., h'^{P_K} }$。然后通过Transformer聚合这$K$个表征:

其中,$W_Q, W_K, W_V, \beta$都是可学习的参数,且所有元路径共享。

将结点标签信息纳入邻居聚合过程。

预先定义元路径的最大长度,然后选取范围内的所有元路径。

TODO

按照论文复现,实现了第一部分:Simplified Neighbor Aggregation、第二部分:Multi-layer Feature Projection、第三部分:Transformer-based Semantic Aggregation。

在ACM、DBLP、IMDB数据集上的实验效果如下:

| 方法\数据集 | ACM | DBLP | IMDB |

|---|---|---|---|

| SeHGNN-论文 | |||

| SeHGNN-v0 | 0.9177, 0.9073 | 0.9500, 0.9398 | 0.5975, 0.5704 |